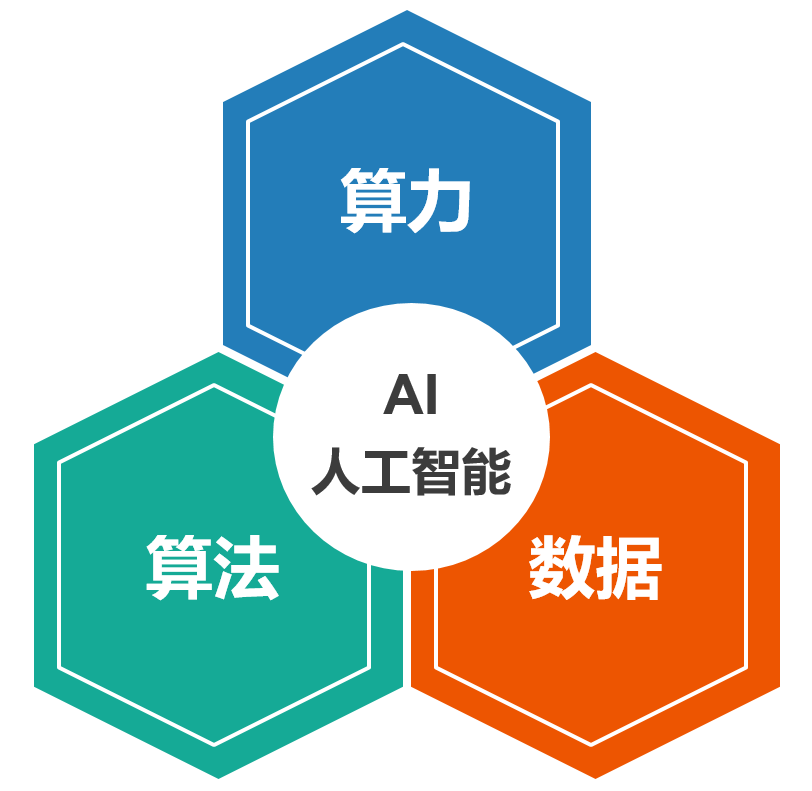

大型语言模型(LLMs)正在彻底改变人工智能领域。这些模型能够理解和生成类似人类的文本,代表了人工智能技术的重大飞跃。

2022年11月,OpenAI推出了其开创性的生成式AI聊天机器人ChatGPT,它吸引了公众和科技界的想象力。这项创新展示了LLMs的巨大潜力,引发了广泛的兴趣和兴奋。

随着这些模型变得更加先进,它们正在扩展到新的应用领域,包括但不限于个性化医疗咨询、法律文件分析、高级教育工具和复杂的情感分析。LLMs的发展不仅推动了技术进步,也促进了对人工智能伦理、可解释性和监管的深入讨论。

未来,我们可能会看到LLMs在更多决策支持系统中发挥作用,帮助人类处理大量信息,做出更加明智的决策。同时,随着技术的不断成熟,确保这些强大工具的负责任使用,避免潜在的滥用和负面影响,将是整个社会需要共同面对的挑战。

继ChatGPT取得突破性成功后,市场上涌现出了大量企业、开发者和个人用户,他们渴望定制自己的人工智能模型。这一趋势凸显了市场对于能够简化生成式人工智能模型开发、集成和管理的高效工具和框架的迫切需求。

在众多选项中,LlamaIndex和LangChain这两个框架因其卓越的性能和特点而成为行业的领头羊。这两个框架各自提供了一系列创新的特性和功能,为那些希望探索并应用大型语言模型(LLMs)的用户提供了一个强大的平台。

LlamaIndex 简介

LlamaIndex 是一个复杂的框架,旨在使用您的专有数据进行索引和查询LLMs。此框架支持广泛的数据源,包括结构化数据(如关系数据库)、非结构化数据(如 NoSQL 数据库)和半结构化数据(如 Salesforce CRM 数据)。

LlamaIndex 的主要优势在于它能够将专有数据索引到最先进的LLMs可以理解的嵌入中,从而消除了从头开始重新训练模型的需要。

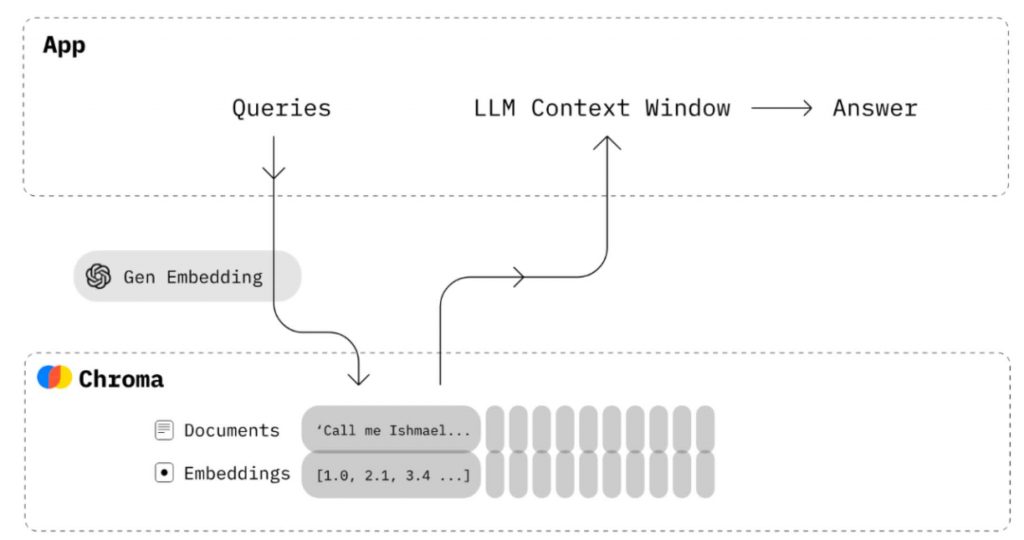

LlamaIndex 的强大之处在于它能够获取您的数据,无论其结构如何,并将其转换为LLMs可以有效理解和利用的格式。此过程涉及创建向量嵌入,这些向量嵌入是数据的数字表示形式,保留了语义意义。通过这样做,LlamaIndex 可以LLMs有效地访问和利用您的数据,提供高度相关和特定于上下文的响应。

LlamaIndex 促进了LLMs下一级的定制,使他们能够成为特定领域的知识专家。这是通过将专有数据嵌入到模型的内存中来实现的,使其能够逐步提供更好的基于上下文的响应。从本质上讲,LlamaIndex 将仿制药LLM转变为专门的 AI 助手或对话聊天机器人,可以根据可靠的事实来源提供准确的答案,例如包含业务特定信息的 PDF 文档。

为了实现这种级别的定制,LlamaIndex 采用了一种称为检索增强生成 (RAG) 的技术。RAG 由两个主要阶段组成:

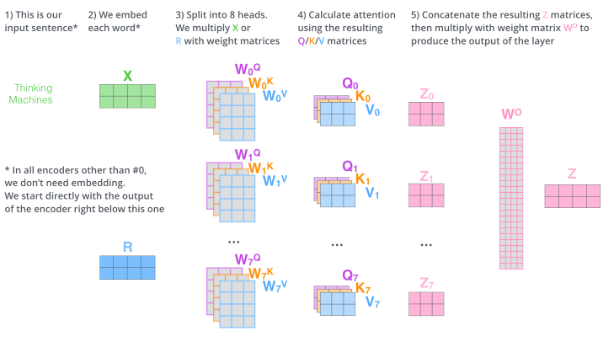

索引阶段:在此阶段,您的专有数据将转换为向量索引。这涉及将数据转换为向量嵌入,向量嵌入是具有语义意义的数字表示。这些嵌入使人们LLM能够有效地理解和解释数据。

查询阶段:当进行查询时,系统会检索与查询语义相似度最高的数据。此检索到的数据以信息块的形式返回,然后与原始查询合并并发送到 LLM.使用此LLM组合输入来生成最终响应。此过程可确保输出高度准确且具有相关性,同时利用数据的基础知识LLM和数据中的特定信息。

LlamaIndex 入门

要开始使用 LlamaIndex,您首先需要安装必要的软件包。使用以下命令安装 LlamaIndex:

pip install llama-indexpip install llama-index openai nltk

此外,您将需要 OpenAI API 密钥才能使用 OpenAI 的 LLM.获取 API 密钥后,请在 .env 文件中设置它,如下所示:

import osos.environ["OPENAI_API_KEY"] = "your_api_key_here"For more detailed guides, examples, and use cases, refer to the LlamaIndex documentation. The documentation provides comprehensive information on how to utilize the framework effectively. Additionally, the Llama Hub offers a wealth of community-shared resources and components that can further enhance your development experience with LlamaIndex.

接下来,使用 LlamaIndex 中的 SimpleDirectoryReader 函数加载文档并构建索引:

from llama_index.core import (VectorStoreIndex,SimpleDirectoryReader)# Define the path inside SDR function and then build an indexdocuments = SimpleDirectoryReader("docs").load_data()index = VectorStoreIndex.from_documents(documents, show_progress=True)

# Query enginequery_engine = index.as_query_engine()response = query_engine.query("If I miss my assignments and projects,what grade and percentage will I end up with?")print(response)

您还可以通过将查询引擎转换为具有内存的聊天引擎来增强功能。这使模型能够在多个交互中维护上下文:

chat_engine = index.as_chat_engine()response = chat_engine.chat("If I miss my assignments and projects,what grade and percentage will I end up with?")print(response)follow_up = chat_engine.chat("And if I only miss my projects,then what grade would I get?")print(follow_up)

为避免每次都重新生成索引,可以将其持久化到磁盘上:

index.storage_context.persist()

您可以在需要时从存储中加载索引:

from llama_index.core import (

来源:AI技术研习社